Karar Ağaçları (Decision Tree)

Karar ağacı algoritması hem regresyon için hem sınıflandırma için kullanabiliriz. İsminden anlaşılacağı üzere bir ağaç yapısı söz konusudur. Kökten başlayarak aşağıya doğru düğümler oluşur. Bu düğümler verideki bazı aralıklara göre belirlenir. Aşağıda görülen basit bir karar ağacı yapısıdır.

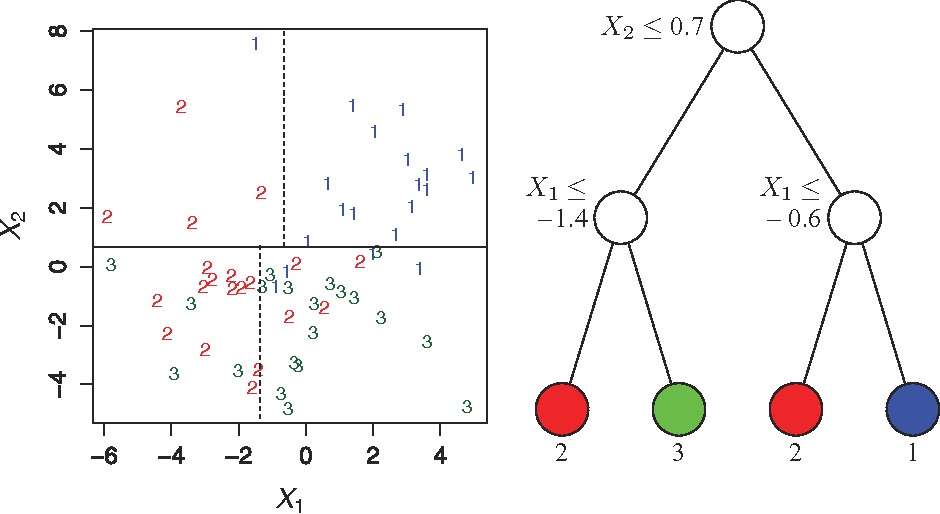

Verimizin bir düzlem de dağıldığını düşünelim. Daha sonra verimizi en uygun sınıflandırma yapacak şekilde kısımlara bölelim veya sınırlandıralım. Örnek soldaki grafik gibi sınırlar çizdik diyelim. Bu sınırları bir ağaç yapısına dönüştürmek istediğimizde sağdaki ağaç yapısı ortaya çıkıyor. Bundan sonra örnek bir veriyi işlemek istediğimizde bu ağaç yapısından geçerek bize ne olduğu hakkında bilgi verecektir.

Örneğin x1=2 ve x2=4 verilerini giriş yaptığımızda bu ağaç yapısına göre bize bu değerlerin mavi renge denk geldiğini bize söyleyecektir.

Daha fazla verimiz oldukça ağaç yapısı değişecektir. Belki çok daha fazla dallara ayrılabilir. Bu da algoritmanın çok daha fazla sınırlandırmalar çizmesi demektir. Sınıflandırma yaparken çok daha güzel sonuçlar verecekken, regresyon yapıldığında çok fazla sınırlar çizebilir. Çizdiği sınırlar içerisinde gelen değerlerin ortalama vs. değerini vereceği için regresyon yerine sınıflandırma(classification) problemlerinin çözümünde daha çok kullanılır.

Sınırların çizilmesinde ilk önce entropi hesapları yapılır. Daha sonra information gain veya gibi index ölçütleri ile sınır çizgiler çizilmiş olur.

Karar ağaçlar ismi gibi daha çok karar mekanizmalarında kullanılır. Örnek bir hastalığın belirlenmesinde, kredi kartı verilmeden kişinin profiline karar verilmesinde veya alışveriş sitelerinde kullanıcının profiline göre satın alıp almayacağını tahmin etmek gibi. Sıkça karşılaştığımız tavsiye algoritmalarında da kullanılmaktadır.

kaynaklar

- Classification and regression trees - Semantic Scholar

- Karar Ağacı Öğrenmesi(Decision Tree Learning) – Yazılıma Giriş